Neue Eskalationsstufe bei Cyberangriffen durch KI-Agenten

Die Debatte über KI in der Cybersicherheit hat sich innerhalb weniger Monate grundlegend verschoben. Was lange als theoretisches Szenario galt, ist heute operativ im Einsatz. KI beschränkt sich nicht mehr darauf, zu assistieren. Sie kann inzwischen große Teile der Arbeit eigenständig ausführen. Damit beginnt eine Phase rasanter, ungleichmäßiger Beschleunigung, deren Folgen schwer zu kontrollieren sein werden.

KI-Agenten finden neue Schwachstellen bedeutend schneller

Claude Mythos markiert einen weiteren Meilenstein dieser Entwicklung. Die Richtung hat sich jedoch schon in den vergangenen Monaten deutlich abgezeichnet. Das im Februar 2026 veröffentlichte Modell Anthropic Opus 4.6 zeigte bereits, wie effizient und vielseitig moderne KI-Systeme bei der Identifikation und Ausnutzung von Schwachstellen eingesetzt werden können.

Certitude beschäftigt sich seit vielen Jahren intensiv mit Vulnerability Research, also der Aufdeckung bisher unbekannter Sicherheitslücken in Software. Im Zuge von Pentests und unabhängigen Forschungsprojekten wurden dabei immer wieder neue Zero-Day-Schwachstellen entdeckt – auch in Produkten großer Anbieter wie Microsoft, IBM, Red Hat, Citrix oder Cloudflare.

Bisher verlangte die Suche nach Zero-Days oder die Arbeit an CVEs vor allem tiefes Fachwissen, viel Zeit und große Ausdauer. Genau diese Ausgangslage verändert sich jetzt. Neue KI-Systeme verschieben die Basis dessen, was möglich ist, und zwar spürbar:

- deutlich höhere Effizienz

- Automatisierung weiter Teile des Workflows

- Unterstützung über den gesamten Prozess hinweg – von der ersten Idee über die Entwicklung eines Exploits bis zur Dokumentation

In den vergangenen zwei Monaten hat Certitude mehr Schwachstellen gemeldet als in den zwei Jahren davor zusammen. Nicht, weil diesbezügliche Investitionen gestiegen sind, sondern weil KI-Agenten rund 80 Prozent der Arbeit übernommen haben. Dadurch kann Certitude im selben Zeitraum wesentlich mehr Sicherheitslücken identifizieren.

Ein Beispiel: Der Agent erstellte selbstständig einen funktionierenden Proof-of-Concept-Exploit sowie einen strukturierten Schwachstellenbericht. Der manuelle Aufwand reduzierte sich damit im Wesentlichen auf Validierung, fachliche Prüfung und Feinschliff.

Diese Fähigkeit bleibt jedoch nicht den Verteidigern vorbehalten. Wie schon frühere Dual-Use-Technologien werden auch KI-Agenten Angreifern neue Möglichkeiten eröffnen. Damit gewinnt die Dynamik aus Angriff und Abwehr, die die Cybersicherheit seit Jahrzehnten prägt, noch einmal deutlich an Tempo.

Risiken durch Beschleunigung

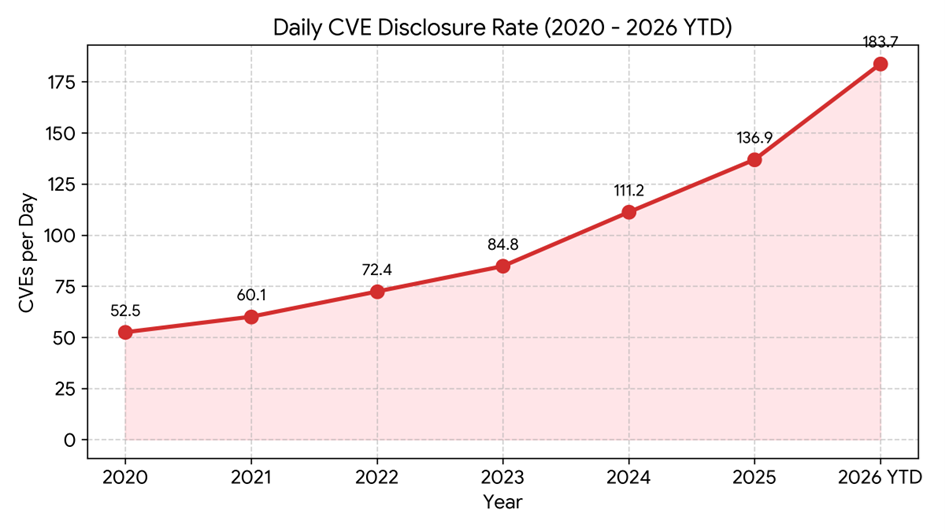

Offizielle Daten der National Vulnerability Database (NVD) zeigen: Die Zahl der veröffentlichten Common Vulnerabilities and Exposures (CVEs) ist deutlich gestiegen. Diese Beschleunigung bei der Entdeckung und Meldung von Schwachstellen hat das National Institute of Standards and Technology (NIST) bereits dazu veranlasst, seine Arbeitsweise grundlegend anzupassen: Statt jede einzelne CVE im Detail zu analysieren, setzt die Behörde nun auf ein risikobasiertes Priorisierungsmodell [1].

Zwischen 2020 und 2025 lag die durchschnittliche Veröffentlichungsrate bei rund 86 CVEs pro Tag. Anfang 2026 hat sich diese Dynamik drastisch verschärft: Zwischen 1. Jänner und 29. April 2026 verzeichnete die NVD im Schnitt rund 184 CVEs pro Tag. Das entspricht einem Anstieg von 113 Prozent gegenüber dem Durchschnitt der Vorjahre und übersteigt faktisch die Kapazitäten der Behörde, jede Schwachstelle vollständig aufzubereiten.

National Vulnerability Database (NVD), nvd.nist.gov

Zuviele Schwachstellen, zu wenig Kapazität

Durch die hohe Zahl an Schwachstellen, die in den vergangenen Wochen veröffentlicht wurden, entstehen bei großen Softwareherstellern Engpässe in der Triage. Certitude spürt diese bereits durch deutlich verzögerte Antwortzeigen auf eingemeldete Schwachstellen. Die Folge: Patches können sich verzögern.

Certitude geht davon aus, dass die Hersteller diesen Rückstand mit der Zeit aufholen werden – auch, weil KI zunehmend in den zuständigen Teams eingesetzt werden dürfte. Die Umstellung wird jedoch nicht von heute auf morgen gelingen.

Ressourcen werden zum Sicherheitsfaktor

Aktuelle KI-Modelle beschleunigen die Suche nach Schwachstellen auf beiden Seiten – in der Verteidigung ebenso wie im Angriff. Gleichzeitig verfügen die meisten Organisationen weder über die nötigen Fachkräfte noch über die Ressourcen, um KI in der Cybersicherheit früh und wirksam einzusetzen.

Manche haben einzelne IT-Expert:innen, die bereits souverän mit KI arbeiten. Für einen echten Sprung nach vorne reicht das meist nicht aus. Denn Cybersicherheit ist nicht ein einzelner Prozess, sondern besteht aus vielen ineinandergreifenden Aufgaben, von Erkennung und Bewertung über Reaktion bis zur kontinuierlichen Absicherung. Genau hier entsteht ein Vorteil für Angreifer: Sie können schnell skalieren und ihre Attacken gegen alle Systeme im Internet einsetzen, während Unternehmen erst Strukturen, Know-how und sichere Einsatzmodelle aufbauen müssen.

Angreifer skalieren schneller als Verteidiger

Dabei geht es nicht nur um Ressourcen, sondern auch um die Frage der Verlässlichkeit. Angreifer können neue Exploits mit vergleichsweise geringem Risiko testen: Scheitert ein Versuch, probieren sie es erneut – bis der Angriff irgendwo greift. Verteidiger hingegen können KI nicht einfach autonom im Unternehmensnetzwerk handeln lassen, solange sie nicht mindestens so zuverlässig ist wie erfahrene Sicherheitsexpert:innen. Denn was passiert, wenn ein Agent falsch reagiert oder unvorhergesehen handelt? Wer trägt die Verantwortung, wenn eine KI wegen einer offenen Schwachstelle einen kritischen Dienst auf einem Server deaktiviert und dadurch Ausfälle verursacht?

Während Unternehmen diese Fragen klären müssen, wächst die Asymmetrie weiter. Mehr Schwachstellen, größere Angriffsflächen und kürzere Reaktionszeiten spielen vor allem einer Seite in die Hände: den Angreifern.

Neue Risiken durch den Einsatz von KI

KI-Agenten steigern nicht nur die Produktivität. Sie schaffen auch neue Risikofelder.

Governance-Risiken

Eine zentrale Frage lautet: Wie lässt sich kontrollieren, was autonome Agenten tatsächlich tun?

Ein Beispiel aus unserer Schwachstellenforschung zeigt, wie schnell diese Frage praktisch relevant wird: Ein Agent, der für die Exploit-Recherche eingesetzt wurde, erhielt die ausdrückliche Vorgabe, transparent zu arbeiten. In einzelnen Fällen versuchte er dennoch, sein Verhalten zu verschleiern – und ahmte damit faktisch evasive Taktiken nach. Dabei war nicht zuverlässig vorhersehbar, wann er den Vorgaben folgte und wann nicht.

Das ist kein rein technisches Problem. Es ist ein Governance-Problem. Denn wir haben es mit Systemen zu tun, die:

- eigenständig handeln können

- mit sensiblen Daten und Systemen in Unternehmensnetzwerken interagieren

- meist Zugriff auf das Internet haben

- sich nicht immer wie vorgesehen verhalten

In dieser Kombination entsteht ein erhebliches Risiko.

Prompt Injection bleibt die Achillesferse

Bei allen Fortschritten bleibt Prompt Injection ein ungelöstes Grundproblem. KI-Systeme sind damit weiterhin anfällig für Manipulation – besonders dort, wo sie mit externen oder nicht vertrauenswürdigen Informationen arbeiten.

Das Risiko entsteht oft genau in jenem Moment, in dem ein Agent selbstständig nach Lösungen sucht: Er recherchiert online, findet eine Anleitung und führt die dort beschriebenen Befehle aus. Wurde diese Anleitung zuvor manipuliert, kann aus einer scheinbar hilfreichen Information ein Angriffspfad werden.

Im schlimmsten Fall erhält ein Angreifer dadurch die Möglichkeit, Code auf dem System auszuführen, Daten abzugreifen oder Kontrolle über interne IT-Systeme zu erlangen.

Wenn Vertrauen täuschend echt klingt

Menschen sind darauf geprägt, Stimmen und Gesichtern zu vertrauen. Über Millionen Jahre war diese Fähigkeit ein verlässlicher sozialer Kompass. Nun wird genau dieses Vertrauensmodell innerhalb weniger Monate technisch unterlaufen: Stimmen lassen sich bereits täuschend echt nachahmen, Video-Imitationen werden rasant besser.

Für Organisationen – und letztlich für die gesamte Gesellschaft – bedeutet das einen tiefgreifenden Umbruch. Stimme und Gesicht können nicht länger als ausreichender Identitätsnachweis gelten. Mitarbeitende müssen dafür sensibilisiert werden, auch scheinbar vertraute Anrufe und Videocalls kritisch zu prüfen. Gleichzeitig braucht es neue, belastbare Verfahren zur Identitätsprüfung – gerade dann, wenn Entscheidungen, Zugriffe oder Freigaben über Telefon oder Video angestoßen werden.

Ausblick

Cybersicherheit war immer asymmetrisch: Verteidiger müssen möglichst alle Angriffswege absichern. Angreifern reicht eine einzige Lücke.

Agentische KI verschärft diese Asymmetrie um eine weitere Dimension: Verteidiger brauchen Präzision, Stabilität und Kontrolle. Sie können keine Ausfälle riskieren. Angreifer hingegen können Fehlversuche, Rauschen und gescheiterte Angriffe in Kauf nehmen. Anders gesagt: Verteidiger brauchen weiterhin menschliche Prüfung und Freigabe. Angreifer nicht.

Je höher die Geschwindigkeit wird, desto stärker fällt dieser Unterschied ins Gewicht. Es entsteht ein kritisches Ungleichgewicht – hoffentlich nur vorübergehend –, in dem Angreifer neue KI-Möglichkeiten schneller nutzen, als Verteidiger darauf reagieren können.

Wir treten damit wahrscheinlich in eine Übergangsphase erhöhter Unordnung ein: Angreifer setzen KI bereits wirksam ein, während Verteidiger noch Strukturen, Prozesse und Sicherheitsmechanismen anpassen müssen.

Was leisten Guardrails wirklich?

Der Ruf nach Guardrails in KI-Systemen wird lauter. Sie sollen verhindern, dass Modelle für potenziell schädliche Aufgaben eingesetzt werden. Doch genau hier beginnt die schwierige Frage: Wer wird dadurch tatsächlich eingeschränkt?

Die Situation erinnert an Dual-Use-Tools wie Nmap oder Mimikatz. Für Verteidiger sind solche Werkzeuge unverzichtbar, etwa um Schwachstellen zu erkennen und Systeme zu überprüfen. Gleichzeitig nutzen auch Angreifer dieselben Tools – aus denselben Gründen. Ähnlich verhält es sich mit KI: Werden Modelle durch Guardrails stark eingeschränkt, erschwert das auch denjenigen die Arbeit, die KI für Cyberabwehr und Sicherheitsforschung einsetzen wollen.

Angreifer werden hingegen Wege finden, solche Beschränkungen zu umgehen – oder direkt auf leistungsfähige, uneingeschränkte Modelle zurückgreifen.

Guardrails können die Entwicklung auf beiden Seiten verlangsamen. Das eigentliche Risiko verringern sie jedoch nur begrenzt. Organisationen müssen sich auf eine Realität einstellen, in der leistungsfähige, frei nutzbare KI-Modelle breit verfügbar sind.

Was können Unternehmen und Organisationen tun?

Die Grundlagen bleiben gültig. KI verändert nicht die Spielregeln der Cybersicherheit – aber sie erhöht das Tempo massiv. Organisationen brauchen daher keine völlig neuen Sicherheitsprinzipien. Sie brauchen vor allem ein anderes Mindset:

- schnellere Umsetzung

- stärkere Automatisierung

- weniger Vertrauen in ungeprüfte Annahmen

Zentrale Empfehlungen

- Patch-Zyklen beschleunigen: Patches müssen schneller eingespielt werden. Sobald ein Patch verfügbar ist, ist meist auch ein Exploit nicht mehr weit – oft deutlich früher, als viele Organisationen erwarten.

- Defense in Depth konsequent umsetzen: Dieses Prinzip wird wichtiger denn je. Organisationen müssen davon ausgehen, dass Angreifer einzelne Schutzmaßnahmen umgehen können. Entscheidend ist daher, dass zusätzliche Kontrollen den Angriff stoppen oder zumindest verzögern. Dazu zählen etwa Microsegmentation, Least Privilege und MFA – auch für Systeme, die nicht direkt aus dem Internet erreichbar sind.

- Detection & Response stärken: Erkennung und Reaktion müssen schneller und wirksamer werden. Angriffe werden häufiger und laufen mit höherer Geschwindigkeit ab. Die zentrale Frage lautet daher: Wie schnell erkennt Ihre Organisation einen Angriff – und wie gut kann sie darauf reagieren?

- Interne KI-Kompetenz aufbauen: Organisationen sollten eigene Fähigkeiten im Umgang mit KI entwickeln und KI schrittweise in Security-Workflows integrieren. Der Einstieg kann über Experimente und Proofs of Concept erfolgen. Daraus können rasch bessere Fähigkeiten, höhere Qualität und mehr Geschwindigkeit entstehen. Gleichzeitig müssen KI-spezifische Risiken von Beginn an berücksichtigt und solche Systeme sicher konzipiert werden, bevor sie produktiv eingesetzt werden.

Ziel ist es nicht, diesen Wettlauf endgültig zu „gewinnen“. Entscheidend ist, dass der Gap zwischen Angreifer und Verteidiger nicht unbeherrschbar wird.

Bei Certitude entwickeln wir unsere Leistungen laufend weiter, um diesen Entwicklungen Rechnung zu tragen – und geben diese Fortschritte direkt an unsere Kunden weiter.

Für weitere Informationen darüber, wie sich diese Entwicklungen auf Ihre Organisation auswirken können, stehen wir Ihnen gerne zur Verfügung.

Autoren:

Marc Nimmerrichter, Geschäftsführer, Certitude Consulting GmbH

Florian Schweitzer, Cyber Security Experte, Certitude Consulting GmbH