Skynet will deine Passwörter! – KI und Social Engineering

Während wir die Fähigkeiten moderner KI zur Unterstützung sowohl in unserem persönlichen als auch im beruflichen Leben erkunden, untersuchen auch bösartige Akteure das Potenzial moderner KI. In dieser Serie von Blogbeiträgen tauchen wir in die Welt der Social Engineering-Angriffe ein, auf die wir uns im Zeitalter fortschrittlicher KI vorbereiten müssen. Wir werden diese Bedrohungen zu erkunden und versuchen zu verstehen, wie wir uns effektiv dagegen verteidigen können. Der erste Beitrag konzentriert sich darauf, aktuelle Angriffsszenarien und potenzielle zukünftige Entwicklungen zu untersuchen.

Computer haben unsere Fähigkeit zur Datenverarbeitung, Simulation und Kommunikation maßgeblich verändert. Ebenso hat KI das Potenzial, die Skalierbarkeit von Aufgaben, die einst menschliche Fähigkeiten erforderten, enorm zu erhöhen. Zum Beispiel erforderte das Verfassen personalisierter E-Mails für tausend Personen früher das Schreiben von tausend separaten E-Mails. Heutzutage können wir jedoch ein Large Language Model (LLM) wie ChatGPT damit beauftragen, diese Kommunikationen zu generieren.

Ähnlich wie bei jedem leistungsstarken Werkzeug kann KI sowohl zu konstruktiven als auch zu schädlichen Zwecken eingesetzt werden. Während wir KI nutzen könnten, um die Erstellung von E-Mails zu delegieren, könnten Angreifer sie ebenso ausnutzen, um Phishing-E-Mails zu generieren. In der Ära vor KI erforderten erfolgreiche Social Engineering-Angriffe eine aufwändige Anpassung der Vorgehensweisen an die einzelnen Opfer, um eine höhere Erfolgsquote zu erzielen. Angesichts des erheblichen Aufwands waren anspruchsvolle Social Engineering-Angriffe daher hauptsächlich auf hochwertige Ziele ausgerichtet, wie etwa einen CFO dazu zu bringen Geld zu überweisen. Heutzutage ermöglichen KI-Tools die gleichzeitige automatisierte Anpassung von Angriffen auf viele einzelne Opfer, wodurch der erforderliche Aufwand erheblich reduziert wird. Daraus ergibt sich die Erwartung eines Anstiegs gezielter Social Engineering-Angriffe, die auf ein breiteres Publikum abzielen.

Moderne KI-Technologien liefern Inhalte, die menschlich generierter Ausgabe (z. B. Text, Zeichnungen) stark ähneln oder die Realität gut abbilden (z. B. Bilder). Arglose Personen würden solche Inhalte womöglich als authentisch wahrnehmen, was sie anfällig für automatisierte Social Engineering-Angriffe macht.

Missbrauchsmöglichkeiten

KI erleichtert bösartigen Akteuren eine Reihe von Social Engineering-Techniken, darunter:

- Generieren realistischer Bilder von Personen, um sie zu imitieren.

- Synthetisieren von Stimmen für Telefonanrufe und andere Audioinhalte.

- Erstellen überzeugender Texte für E-Mails und Chat-Nachrichten, die selbst vorsichtige Leser täuschen können.

Die bisherigen Vorfälle dieser Angriffe kratzen nur an der Oberfläche. Mit dem Fortschreiten der KI-Technologie können wir zunehmend raffiniertere und vielfältigere Angriffsvektoren erwarten, einschließlich Videoimitation und anderen Formen von „Deepfake“-Medien.

Autonome KI und die Zukunft

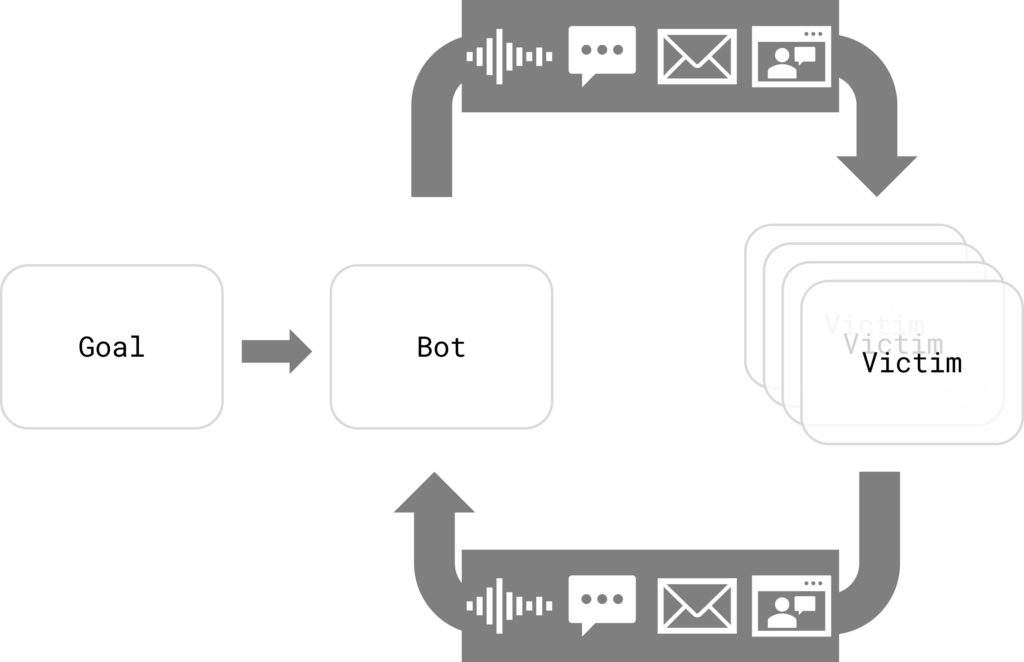

Autonome Agenten, wie sie beispielsweise von Systemen wie AutoGPT umgesetzt werden, bringen eine neue Flexibilität in die Welt der KI. Anstatt KI einzelne Aufgaben zuzuweisen, können autonome Agenten eine Vielzahl individueller Aktionen durchführen, um umfangreichere Ziele zu erreichen. Ein Angreifer könnte beispielsweise eine autonome KI-Entität aufsetzen und sie anweisen, Geld zu stehlen. Die KI könnte dann systematisch alle erforderlichen Schritte ausführen: Ziele identifizieren, relevante Informationen sammeln, personalisierte Angriffsstrategien maßschneidern, Websites, E-Mail-Adressen und Telefonleitungen erstellen, den Angriff selbst durchführen und die Taktiken bei Bedarf anpassen.

Fazit

Unabhängig davon, ob KI überbewertet wird, lässt sich das potenzielle Ausmaß der Auswirkungen von KI-Technologien auf unser Leben nicht leugnen. In vielerlei Hinsicht ist das Kind bereits in den Brunnen gefallen – da die Technologie weit verbreitet verfügbar ist, wird sie genutzt werden. Dies gilt insbesondere für bösartige Akteure, die keine rechtlichen Einschränkungen beachten werden, die möglicherweise in Zukunft festgelegt werden. Wir müssen daher darauf vorbereitet sein, uns gegen diese Arten von Angriffen zu verteidigen, was wir in einem zukünftigen Beitrag genauer untersuchen werden.

In unserem kommenden Blogbeitrag, welcher Teil dieser Serie ist, werden wir uns mit verschiedenen Verteidigungsstrategien gegen solche KI-Social-Engineering Angriffe beschäftigen.

Eine Liste aller verfügbaren Beiträge dieser Reihe finden Sie auch unter folgendem Link.

1 In dieser Serie werden wir die Begriffe KI und ML (Machine Learning) synonym verwenden. Obwohl sich die Serie beinahe ausschließlich um ML dreht, wird der Begriff KI verwendet, da dieser de facto zum Synonym geworden ist.